16 kwietnia 2026 roku Alibaba opublikowała na HuggingFace nowy model: Qwen3.6-35B-A3B. Na pierwszy rzut oka kolejny release z Chin. Kluczowe jest to, co przyszło razem z wagami: licencja Apache 2.0, czyli pełne prawo komercyjnego użycia. Zero opłat API, zero limitów tokenów, zero pytania o zgodę do działu prawnego. Kiedy praktycznie każdy liczący się LLM jest zamknięty za API, to ruch, który zasługuje na uwagę polskich firm pracujących nad własnymi agentami. Co ciekawsze, benchmarki wskazują, że Qwen3.6-35B-A3B dorównuje w zadaniach wizualnych Claude Sonnet 4.5, a w kodowaniu bije Gemma 4. A działa lokalnie na domowym sprzęcie, jeśli umiesz zrobić kwantyzację. Ten artykuł to mapa: co to za model, co oznacza “35B z 3B aktywnych”, jak wypada w testach, jak uruchomić w Ollamie i spiąć z n8n.

Co to jest Qwen3.6-35B-A3B i dlaczego wszyscy o nim mówią?

Qwen3.6-35B-A3B to otwarty, multimodalny model językowy od zespołu Qwen w Alibabie, udostępniony 16 kwietnia 2026 roku na licencji Apache 2.0. Przyjmuje na wejściu zarówno tekst, jak i obrazy, a na wyjściu generuje tekst. Działa w trybie “thinking” (z wewnętrznym rozumowaniem) oraz “non-thinking” (szybkie odpowiedzi). Natywny kontekst to 262 tysiące tokenów, rozszerzalny do miliona z techniką YaRN.

Powodów hype’u jest kilka. Po pierwsze, architektura – to model z przełączanymi ekspertami (MoE, czyli Mixture of Experts). W sumie 35 miliardów parametrów, ale tylko 3 miliardy aktywuje się na jedno pytanie. Dla użytkownika to oznacza, że model jest dużo tańszy w uruchamianiu niż “ciężki” 35-miliardowy monolityczny LLM, a jakość odpowiedzi zbliża się do gęstych modeli 70B+.

Po drugie, licencja Apache 2.0. To jedna z najbardziej permisywnych licencji w świecie open source. Możesz pobrać model, uruchomić go komercyjnie w produkcie, zmodyfikować, przepakować, nawet sprzedać jako część swojej oferty – bez opłat, bez zgody Alibaby. W praktyce: firma w Polsce może postawić go na własnym serwerze i używać do automatyzacji, nie wysyłając ani jednego bajta danych do chmury.

Po trzecie, Qwen3.6-35B-A3B zamyka lukę między zamkniętym Qwen3.6-Plus a open source. O zamkniętym, komercyjnym Qwen3.6-Plus i jego benchmarkach w agentowym kodowaniu pisaliśmy w artykule Qwen3.6-Plus – agenty AI, kodowanie i benchmarki. Teraz Alibaba daje wersję open-source-ową.

Model, który w zadaniach wizualnych dorównuje Claude Sonnet 4.5, z licencją pozwalającą postawić go w firmowej serwerowni bez pytania o zgodę.

Co oznacza “35B z 3B aktywnych” – tłumaczenie dla nie-deweloperów

Zacznijmy od analogii. Klasyczny model 35-miliardowy to jak biuro, w którym każda osoba musi siedzieć przy biurku cały dzień, nawet jeśli dostaje 30 minut pracy. Duża pensja, duże koszty, mała wydajność. MoE to biuro, w którym jest 35 specjalistów, ale do każdego zadania wstaje tylko trzech – akurat ten specjalista od podatków, od księgowości i od HR. Reszta siedzi w kuchni. Wynik? Te same kompetencje, zlecenie robi się tak samo dobrze, a rachunki za energię są wielokrotnie mniejsze.

W kodzie wygląda to tak: model ma zespół 128 “ekspertów”, czyli wyspecjalizowanych podmodułów. Router w pierwszej warstwie ocenia, które trzy eksperty poradzą sobie najlepiej z aktualnym pytaniem, i tylko ich uruchamia. Reszta jest zapisana w pamięci, ale nie zużywa mocy obliczeniowej.

Jakie to ma praktyczne znaczenie dla polskiej firmy?

Karta GPU 24 GB VRAM (np. RTX 4090 albo używana A4000) wystarczy do uruchomienia Qwen3.6-35B-A3B w kwantyzacji Q4. Gęsty model 35B wymagałby 48 GB lub więcej, co oznacza zakup sprzętu za 50-100 tysięcy złotych. Dzięki MoE koszt wejścia spada do 10-15 tysięcy zł za domowy serwer. A jeśli firma ma już serwer z kartą serwerową (np. A6000 48 GB), mieści się tam Qwen w pełnej precyzji BF16.

Drugi plus – szybkość. Sparse MoE generuje tokeny z prędkością zbliżoną do modeli 7-10B, bo tylko one są w pełni aktywne. Dla n8n workflow, gdzie liczy się czas odpowiedzi, ma to realne znaczenie.

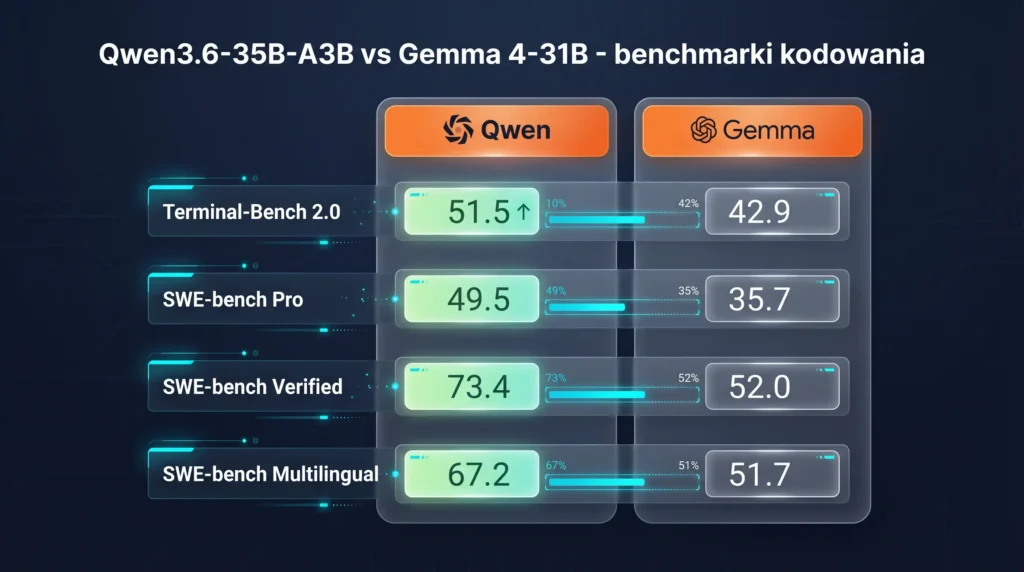

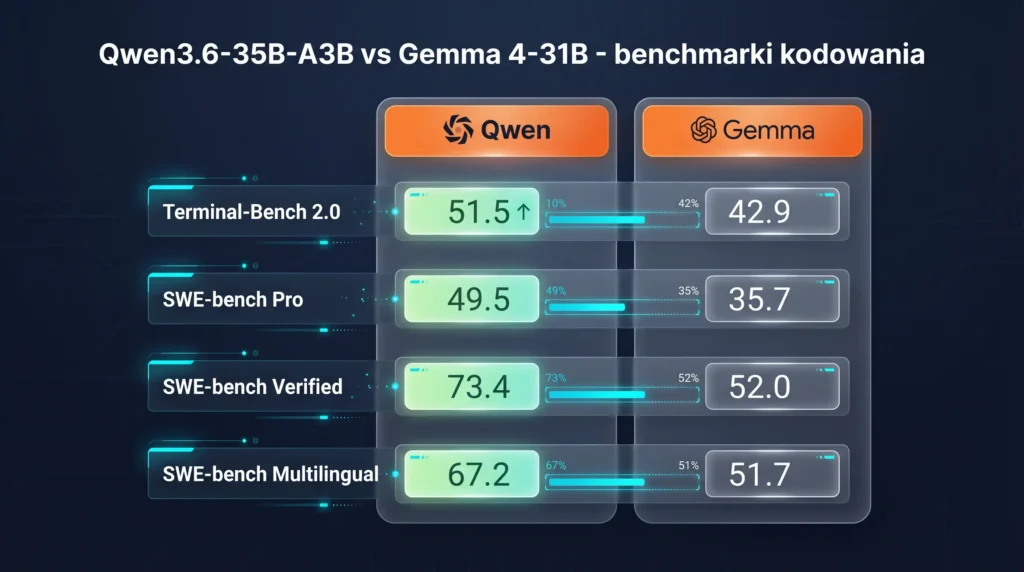

Jak Qwen3.6-35B-A3B wypada na benchmarkach vs Claude i Gemma?

Alibaba pokazała konkretne liczby, które można zweryfikować. Poniżej najważniejsze.

Przyjrzyjmy się liczbom z bliska:

- Terminal-Bench 2.0 (agent w terminalu): Qwen 51,5 vs Gemma 42,9 – przewaga 8,6 pkt

- SWE-bench Pro (naprawianie prawdziwych bugów): Qwen 49,5 vs Gemma 35,7 – przewaga 13,8 pkt

- SWE-bench Verified: Qwen 73,4 vs Gemma 52,0 – przewaga 21,4 pkt

- SWE-bench Multilingual: Qwen 67,2 vs Gemma 51,7 – przewaga 15,5 pkt

To są zadania, które odzwierciedlają realną pracę z kodem. Model dostaje prawdziwy issue z GitHuba, ma zaproponować patch, a benchmark sprawdza, czy patch działa. Qwen wygrywa każdą z tych czterech konkurencji wyraźnie.

W zadaniach wizualnych model zbliża się do Claude Sonnet 4.5. Na RefCOCO (rozumienie przestrzenne obiektów na zdjęciu) Qwen osiąga 92,0, a na ODInW13 (detekcja obiektów) 50,8. W tych dwóch testach bije Sonneta, chociaż w ogólnych benchmarkach vision-language zazwyczaj idą łeb w łeb.

Dla kodu Qwen nie dorównuje Claude Opus 4.7 w najtrudniejszych zadaniach agentowych. Ale tu mówimy o rywalizacji między modelem za 5 dolarów na milion tokenów i modelem, który pobierasz za darmo i uruchamiasz u siebie. Dla 80% zadań w firmie różnica jest wystarczająco mała, żeby zmienić kalkulację.

Jak uruchomić Qwen3.6-35B-A3B lokalnie w Ollamie i podłączyć do n8n?

HuggingFace udostępnia oryginalne wagi pod adresem huggingface.co/Qwen/Qwen3.6-35B-A3B. Dla większości użytkowników łatwiejszą drogą jest jednak Ollama – menedżer lokalnych modeli, który upakowuje kwantyzację, runtime i API w jednej komendzie.

Krok 1: instalacja Ollamy. Pobierasz ze strony ollama.com (Windows, Mac, Linux). Po instalacji w terminalu:

ollama pull qwen3.6:35b-a3b-q4

ollama run qwen3.6:35b-a3b-q4

Kwantyzacja Q4 oznacza, że wagi zostały skompresowane do 4 bitów zamiast natywnego 16. Jakość minimalnie spada, ale wymagania VRAM lecą do około 20 GB. Dla RTX 4090 z 24 GB zapasu jest w sam raz.

Krok 2: sprawdź, czy działa. W terminalu wpisujesz pytanie, model odpowiada. Jeśli trzaska błędami OOM (out of memory), spróbuj Q3 lub przełącz się na CPU + RAM (wolniej, ale działa).

Krok 3: podłączenie do n8n. Ollama wystawia API kompatybilne z OpenAI na http://localhost:11434/v1. W n8n dodajesz credential “OpenAI” (albo “Anthropic”, Ollama obsługuje oba), ale w polu base URL wpisujesz adres Ollamy zamiast api.openai.com. Model name: qwen3.6:35b-a3b-q4. W naszych projektach klienckich widzieliśmy, że ta konfiguracja działa praktycznie od razu, a cała migracja z chmurowego GPT-4 na lokalnego Qwena zajmuje popołudnie.

Krok 4: MCP dla agentów. Jeśli chcesz, żeby Qwen był częścią agenta AI (wywoływał narzędzia, czytał pliki, odpowiadał asynchronicznie), dołóż warstwę Model Context Protocol. Dzięki MCP Qwen w n8n dostaje dostęp do narzędzi dokładnie tak, jak Claude w swojej chmurze – z tą różnicą, że żaden bajt nie wychodzi z firmy.

Dla osób, które pracują nad własnymi agentami, polecamy też nasz przewodnik 12-factor agents – jak budować agenty AI w produkcji, który jest niezależny od konkretnego modelu.

Kurs n8n 2.0 · Kodożercy

n8n + AI = automatyzacje, które naprawdę myślą

n8n pozwala podłączyć modele AI do swoich workflow – wysyłać dane do ChatGPT, analizować wyniki, reagować automatycznie. Kurs n8n 2.0 na Kodożercach pokaże Ci jak to połączyć.

Sprawdź jak to działa →

Apache 2.0 i komercyjne użycie – co wolno polskiej firmie?

Licencja Apache 2.0 jest prosta i biznesowo przyjazna. Krótka lista tego, co wolno:

- Pobrać, uruchomić, wdrożyć w swojej firmie

- Zmodyfikować model, dotrenować na własnych danych

- Włączyć do własnego produktu komercyjnego i sprzedawać ten produkt

- Zmienić nazwę i przepakować pod własną marką

Krótka lista tego, co musisz zachować:

- Załączyć oryginalną licencję Apache 2.0 w dystrybucji

- Zaznaczyć, że model bazuje na pracy Alibaby (atrybucja)

- Zachować oryginalne oświadczenie o braku gwarancji

W odróżnieniu od modeli na licencjach “quasi-open” (np. Llama 3 z ograniczeniami dla firm powyżej 700 milionów użytkowników), Apache 2.0 nie ma ograniczeń skali. Polska firma z 10 milionami użytkowników może używać Qwena na tych samych warunkach co student testujący model na lokalnym laptopie.

Co z RODO? Lokalne uruchomienie modelu to dokładnie ta odpowiedź, której potrzebują firmy z danymi wrażliwymi. Jeśli model działa na firmowym serwerze, dane nigdy nie opuszczają infrastruktury. Art. 32 RODO (środki bezpieczeństwa) jest spełniony z definicji. O zagrożeniach wypływu danych firmowych do chmurowego ChatGPT pisaliśmy w osobnym artykule firmowe dane AI wyciek – jak zabezpieczyć firmę.

Warto też pamiętać o EU AI Act. Od 2 lutego 2026 nakłada on dodatkowe obowiązki przy systemach wysokiego ryzyka. Szczegóły opisaliśmy w tekście EU AI Act a polska firma. Używanie modelu open source nie zwalnia z tych obowiązków, ale daje pełną przejrzystość.

FAQ – najczęstsze pytania o Qwen3.6-35B-A3B

Ile VRAM trzeba, żeby uruchomić Qwen3.6-35B-A3B lokalnie?

Zależy od kwantyzacji. Kwantyzacja Q4 (4-bitowa) wymaga około 20 GB VRAM, czyli mieści się na RTX 4090 czy A4000. Kwantyzacja Q3 zejdzie do ~16 GB. Pełna precyzja BF16 wymaga ok. 70 GB, co oznacza karty serwerowe w duchu H100 albo A100 80 GB.

Czy Qwen3.6-35B-A3B obsługuje język polski?

Tak, Qwen jest trenowany multilingualnie. Polski nie jest jego pierwszym językiem, ale jakość odpowiedzi w pisaniu, kodowaniu i tłumaczeniach z polskiego na angielski jest porównywalna z Gemma 4. Dla najlepszych rezultatów w polskim warto dotrenować model na firmowych dokumentach (fine-tuning na Apache 2.0 jest dozwolony).

Jak licencja Apache 2.0 różni się od licencji Llama?

Apache 2.0 nie ma żadnych ograniczeń skali ani branży. Licencja Meta Llama (tzw. Llama Community License) zabrania używania modelu jako podstawy do trenowania konkurencyjnych LLM oraz wprowadza ograniczenia dla firm powyżej 700 mln aktywnych użytkowników miesięcznie. Apache 2.0 nie ma żadnego z tych ograniczeń.

Czy mogę dotrenować Qwen na własnych danych firmowych?

Tak, licencja wprost na to pozwala. Fine-tuning na firmowych dokumentach, rozmowach z klientami czy kodzie to jeden z mocniejszych przypadków użycia. Dzięki temu model poznaje słownictwo branżowe i styl komunikacji firmy. W kursie n8n 2.0 pokazujemy pełny pipeline fine-tuningu dla modelu open-source, który wykorzystujemy w agentach.

Czy Qwen3.6-35B-A3B zastąpi mi ChatGPT i Claude w firmie?

Dla 70-80% zadań biurowych i deweloperskich – tak. Dla najtrudniejszych zadań agentowych (długi kontekst, skomplikowane wieloetapowe rozumowanie) Claude Opus 4.7 czy GPT-4 nadal wygrywają. Dobry pattern to hybryda: Qwen lokalnie do szybkich, rutynowych zadań oraz wrażliwych danych, a zamknięty model chmurowy do trudniejszych przypadków.

Podsumowanie

Qwen3.6-35B-A3B to otwarty model Alibaby wydany 16 kwietnia 2026 roku na HuggingFace z licencją Apache 2.0. Architektura MoE z 35 miliardami parametrów total i 3 miliardami aktywnych na raz daje jakość zbliżoną do modeli gęstych 70B+, przy koszcie uruchomienia modelu 7-10B. Benchmarki: wygrywa z Gemma 4-31B w każdym z czterech testów kodowania, dorównuje Claude Sonnet 4.5 w zadaniach wizualnych, w niektórych (RefCOCO, ODInW13) nawet go bije. Licencja pozwala na pełne komercyjne użycie, bez ograniczeń skali. Uruchomienie lokalne wymaga ok. 20 GB VRAM przy kwantyzacji Q4, co mieści się na RTX 4090. Integracja z n8n przez API kompatybilne z OpenAI zajmuje jedno popołudnie. Dla firm, które chcą korzystać z AI bez wysyłania danych do chmury, to moment, w którym kalkulacja się zmienia.

Newsletter · DevstockAcademy & Kodożercy

Bądź na bieżąco ze światem IT, AI i automatyzacji

Co wtorek: newsy z branży, praktyczne tipy i narzędzia które warto znać. Zero spamu.